EEG2Rep: Eine selbstüberwachte KI-Architektur für die Modellierung von EEG-Daten

H.B. Duran

Aktualisiert am

22.05.2024

EEG2Rep: Eine selbstüberwachte KI-Architektur für die Modellierung von EEG-Daten

H.B. Duran

Aktualisiert am

22.05.2024

EEG2Rep: Eine selbstüberwachte KI-Architektur für die Modellierung von EEG-Daten

H.B. Duran

Aktualisiert am

22.05.2024

Wir freuen uns, bekannt zu geben, dass das Papier „EEG2Rep: Verbesserung der selbstüberwachenden EEG-Darstellung durch informative maskierte Eingaben“ zur Präsentation auf der renommierten KDD 2024-Konferenz angenommen wurde.

Navid Foumani ist der Hauptautor. Die Co-Autoren sind Dr. Mahsa Salehi (Monash University), Dr. Geoffrey Mackellar, Dr. Soheila Ghane, Dr. Saad Irtza und Dr. Nam Nguyen (EMOTIV Research, Pty Ltd).

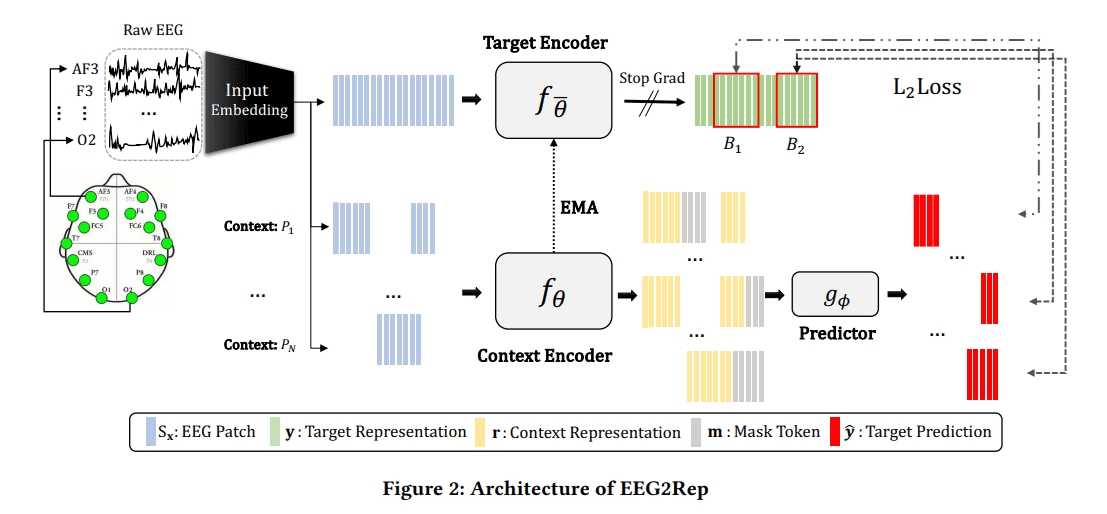

EMOTIV sponsert Navid Foumani, einen Doktoranden, der an der Anwendung von Deep-Learning-Methoden auf EEG-Daten unter der Aufsicht von Dr. Mahsa Salehi an der Monash University in Melbourne, Australien, arbeitet. Navid arbeitete eng mit unserem Team zusammen, um eine neuartige selbstüberwachende Architektur namens EEG2Rep zu entwickeln, die äußerst vielversprechend für die Modellierung von EEG-Daten ist.

Als eines von 5 EEG-Datensätzen wandte Navid diese Methoden auf unsere Daten zur Fahreraufmerksamkeit an: 18 Subjekte x 45 Minuten simuliertes Fahren mit intermittierenden Ablenkungen, die typisch für eine Fahrerfahrung sind (Anrufe, Textnachrichten, Navigation, Musikauswahl, Gespräche, mentale Berechnungen in Echtzeit usw.). Unser Algorithmus zur Fahreraufmerksamkeit wurde 2013 mit einem Genauigkeitswert von 68 % unter Verwendung modernster Machine-Learning-Methoden geliefert.

Wir haben Mahsa während ihrer Promotion an der Melbourne University im Jahr 2015 unterstützt und ihr denselben Datensatz zur Verfügung gestellt. Sie konnte den Genauigkeitswert auf 72 % mit Ensemblemethoden verbessern.

Das EEG2Rep-Modell wurde auf den Datensatz zur Ablenkung des Fahrers angewendet und erreichte die bislang höchste Genauigkeit von 80,07 %, eine erhebliche Verbesserung. Darüber hinaus übertraf das Modell moderne Methoden erheblich in jedem der fünf öffentlichen Datensätze, einschließlich der Erkennung emotionaler und mentaler Zustände, Multitasking, Ruhe-EKG und der Erkennung medizinischer Zustände wie Epilepsie und Schlaganfall.

Dieser Erfolg eröffnet die Möglichkeit, ein grundlegendes Modell für EEG-Daten zu entwickeln, das über verschiedene Aufgaben und Anwendungen hinweg verallgemeinert werden kann, und erweitert die Grenzen dessen, was im Bereich der EEG-Analyse erreicht werden kann.

Wir freuen uns, bekannt zu geben, dass das Papier „EEG2Rep: Verbesserung der selbstüberwachenden EEG-Darstellung durch informative maskierte Eingaben“ zur Präsentation auf der renommierten KDD 2024-Konferenz angenommen wurde.

Navid Foumani ist der Hauptautor. Die Co-Autoren sind Dr. Mahsa Salehi (Monash University), Dr. Geoffrey Mackellar, Dr. Soheila Ghane, Dr. Saad Irtza und Dr. Nam Nguyen (EMOTIV Research, Pty Ltd).

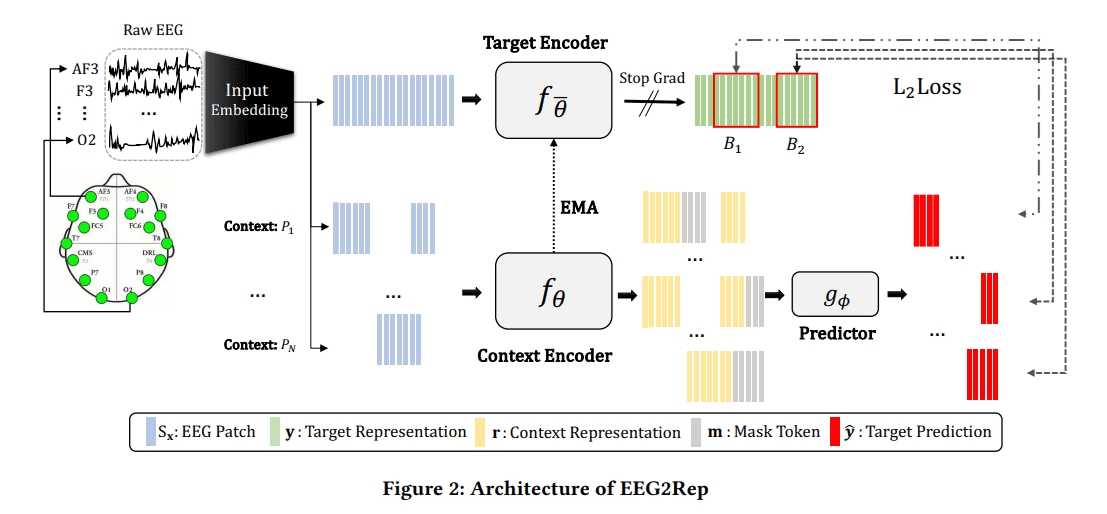

EMOTIV sponsert Navid Foumani, einen Doktoranden, der an der Anwendung von Deep-Learning-Methoden auf EEG-Daten unter der Aufsicht von Dr. Mahsa Salehi an der Monash University in Melbourne, Australien, arbeitet. Navid arbeitete eng mit unserem Team zusammen, um eine neuartige selbstüberwachende Architektur namens EEG2Rep zu entwickeln, die äußerst vielversprechend für die Modellierung von EEG-Daten ist.

Als eines von 5 EEG-Datensätzen wandte Navid diese Methoden auf unsere Daten zur Fahreraufmerksamkeit an: 18 Subjekte x 45 Minuten simuliertes Fahren mit intermittierenden Ablenkungen, die typisch für eine Fahrerfahrung sind (Anrufe, Textnachrichten, Navigation, Musikauswahl, Gespräche, mentale Berechnungen in Echtzeit usw.). Unser Algorithmus zur Fahreraufmerksamkeit wurde 2013 mit einem Genauigkeitswert von 68 % unter Verwendung modernster Machine-Learning-Methoden geliefert.

Wir haben Mahsa während ihrer Promotion an der Melbourne University im Jahr 2015 unterstützt und ihr denselben Datensatz zur Verfügung gestellt. Sie konnte den Genauigkeitswert auf 72 % mit Ensemblemethoden verbessern.

Das EEG2Rep-Modell wurde auf den Datensatz zur Ablenkung des Fahrers angewendet und erreichte die bislang höchste Genauigkeit von 80,07 %, eine erhebliche Verbesserung. Darüber hinaus übertraf das Modell moderne Methoden erheblich in jedem der fünf öffentlichen Datensätze, einschließlich der Erkennung emotionaler und mentaler Zustände, Multitasking, Ruhe-EKG und der Erkennung medizinischer Zustände wie Epilepsie und Schlaganfall.

Dieser Erfolg eröffnet die Möglichkeit, ein grundlegendes Modell für EEG-Daten zu entwickeln, das über verschiedene Aufgaben und Anwendungen hinweg verallgemeinert werden kann, und erweitert die Grenzen dessen, was im Bereich der EEG-Analyse erreicht werden kann.

Wir freuen uns, bekannt zu geben, dass das Papier „EEG2Rep: Verbesserung der selbstüberwachenden EEG-Darstellung durch informative maskierte Eingaben“ zur Präsentation auf der renommierten KDD 2024-Konferenz angenommen wurde.

Navid Foumani ist der Hauptautor. Die Co-Autoren sind Dr. Mahsa Salehi (Monash University), Dr. Geoffrey Mackellar, Dr. Soheila Ghane, Dr. Saad Irtza und Dr. Nam Nguyen (EMOTIV Research, Pty Ltd).

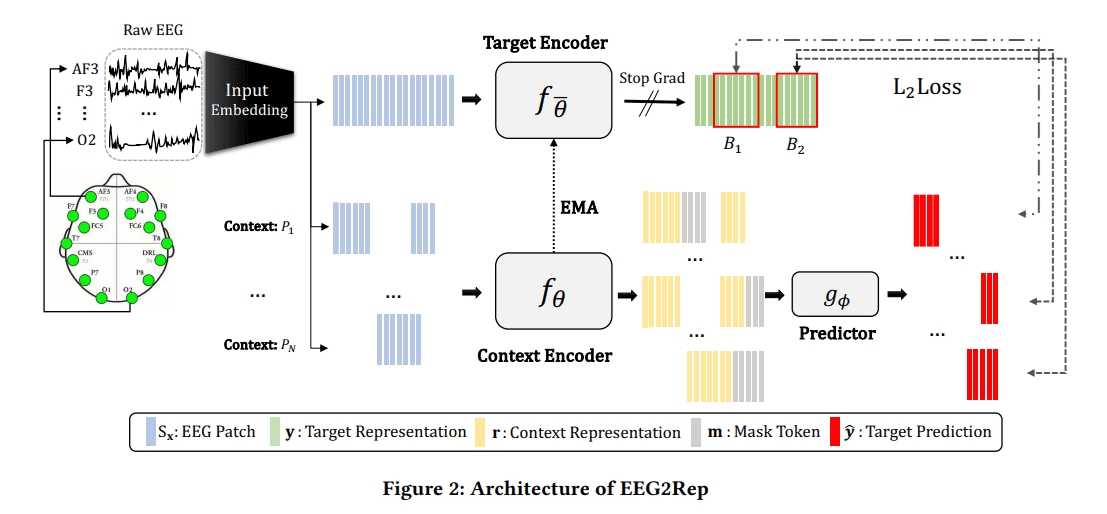

EMOTIV sponsert Navid Foumani, einen Doktoranden, der an der Anwendung von Deep-Learning-Methoden auf EEG-Daten unter der Aufsicht von Dr. Mahsa Salehi an der Monash University in Melbourne, Australien, arbeitet. Navid arbeitete eng mit unserem Team zusammen, um eine neuartige selbstüberwachende Architektur namens EEG2Rep zu entwickeln, die äußerst vielversprechend für die Modellierung von EEG-Daten ist.

Als eines von 5 EEG-Datensätzen wandte Navid diese Methoden auf unsere Daten zur Fahreraufmerksamkeit an: 18 Subjekte x 45 Minuten simuliertes Fahren mit intermittierenden Ablenkungen, die typisch für eine Fahrerfahrung sind (Anrufe, Textnachrichten, Navigation, Musikauswahl, Gespräche, mentale Berechnungen in Echtzeit usw.). Unser Algorithmus zur Fahreraufmerksamkeit wurde 2013 mit einem Genauigkeitswert von 68 % unter Verwendung modernster Machine-Learning-Methoden geliefert.

Wir haben Mahsa während ihrer Promotion an der Melbourne University im Jahr 2015 unterstützt und ihr denselben Datensatz zur Verfügung gestellt. Sie konnte den Genauigkeitswert auf 72 % mit Ensemblemethoden verbessern.

Das EEG2Rep-Modell wurde auf den Datensatz zur Ablenkung des Fahrers angewendet und erreichte die bislang höchste Genauigkeit von 80,07 %, eine erhebliche Verbesserung. Darüber hinaus übertraf das Modell moderne Methoden erheblich in jedem der fünf öffentlichen Datensätze, einschließlich der Erkennung emotionaler und mentaler Zustände, Multitasking, Ruhe-EKG und der Erkennung medizinischer Zustände wie Epilepsie und Schlaganfall.

Dieser Erfolg eröffnet die Möglichkeit, ein grundlegendes Modell für EEG-Daten zu entwickeln, das über verschiedene Aufgaben und Anwendungen hinweg verallgemeinert werden kann, und erweitert die Grenzen dessen, was im Bereich der EEG-Analyse erreicht werden kann.